Google Omni AI 视频生成器

打开对话框,描述场景,在对话里反复打磨,直到它真正属于你。Gemini 命名为「Omni」的 chat-edit 视频工作流 —— 浏览器里今天就能用。不排队、不要 API、零安装。底层使用 Gemini 视频堆栈(Veo 3.1,Omni 的扩展底座);Google 一发布 Omni,工作台自动切换。

由 Gemini 视频堆栈驱动 —— 描述、混剪、渲染

来自 9to5Google、TestingCatalog、Chrome Unboxed 和 r/GeminiAI 的可验证泄露

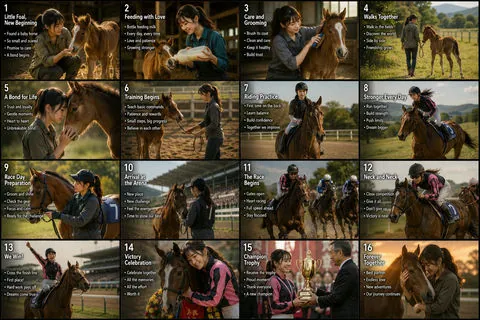

真实 Google Omni 视频演示 —— 来自泄露工作流的输出

下面这两个 prompt 就是 Reddit 测试者 @Zacatac_391 于 2026-05-11 在泄露的 Gemini Omni 界面里跑的同款 —— 通过 Omni 扩展的 Gemini 视频堆栈生成。用大白话描述一个场景、渲染,然后在对话里继续打磨镜头、音频或台词 —— 无需离开画布。

海边餐厅意面 —— 双人对话 | Google Omni 视频演示

产品开箱 —— 电影级俯拍 | Google Omni 视频演示

动漫片头 —— 多机位切换 | Google Omni 视频演示

美食 ASMR —— 俯拍微距 | Google Omni 视频演示

电影级对话特写 | Google Omni 视频演示

城市街道 —— 现场纪实 | Google Omni 视频演示

MV 片头 —— 风格化调色 | Google Omni 视频演示

自然广角 —— 无人机航拍 | Google Omni 视频演示

像素游戏 cutscene | Google Omni 视频演示

中世纪港口 —— 世界观广角 | Google Omni 视频演示

汽车追逐 —— 动作戏 | Google Omni 视频演示

Publish Everywhere

披露 Gemini Omni 泄露事件的媒体

Google Omni 是什么 —— Gemini 的新视频模型

Google Omni(亦称 Gemini Omni)是 Google Gemini App 里浮出水面的新 AI 视频生成模型。2026 年 5 月,X 用户 @Thomas16937378 在 Gemini App 里截到 UI 字串「Create with Gemini Omni —— Meet our new video model. Remix your videos, edit directly in chat, try a template, and more.」,该截图随后被 9to5Google、TestingCatalog 与 Chrome Unboxed 等媒体转载并验证。元数据显示 Omni 是现有 Gemini 视频堆栈(内部代号 Toucan,当前由 Veo 3.1 驱动)的扩展。aigeminiomni.org 让你今天就能跑通同一套 chat-edit 工作流;看创作者在工作台里做了什么 或 打开工作台 立即生成你的第一段视频。

对话原生视频编辑

别打开时间线。把改动说出来。Google Omni 的核心 UI 字串「edit directly in chat」把视频变成一份可对话的文档。想换更紧的镜头?暖色调?换一句台词?打字。Gemini 视频堆栈只重新渲染你改的部分。

任意视频一键 Remix

每个 Google Omni 生成结果都是 remix 种子。「Remix your videos」是 Google 在 Gemini App 里预告的第二根支柱。换主角、换机位、换时段、换整个场景 —— 一键完成。原版保留,变体属于你。

不像模板的模板

「Try a template」是 Gemini Omni 的第三根支柱 —— 但这里的模板是开始的笑点,不是结束的标准答案。从电影对白、动漫片头、俯拍 ASMR、产品开箱开始,然后用对话把它弯到没人猜得到原始模板是哪个。

原生音频、多机位、环境配乐

Reddit 测试者 @Zacatac_391 说语音质量「比 Veo 好得多,差距相当大」,并发现 Omni 在餐厅场景里「甚至加了一段轻柔背景音乐」。无缝多机位切换是 Omni 的招牌 —— 这一切发生在一个镜头里,无需剪辑。

为什么 Google Omni 工作流重要

今天大多数视频 AI 要求你写一个完美 prompt、按生成、烧香。Google Omni 的 chat-edit 模式反转了这个循环:你从粗糙开始,用对话精修,永远不离开画布。当模型住在对话里,会发生什么变化?

工作流优势

不要时间线、不要 After Effects、不重渲全片

传统视频 AI 给你一个片段,然后把你扔回时间线。Google Omni 把每一次微调留在同一对话里 —— 换脸、改台词、收紧镜头 —— 模型只重渲差异。Reddit 测试者反馈机位切换「频繁切换且具备良好连贯性」。

Google Omni 工作流怎么用

四步。一个画布。Gemini 预告的 Omni 工作流 —— 描述、演示、运行,现在你的浏览器里就能跑。

1. 描述场景

打开工作台。挑一个模板或直接打字写场景 —— 「教授在黑板上演算三角恒等式」或「两个男人在海边餐厅吃意面」。只用大白话。无需 prompt 工程。

2. 生成第一段视频

Gemini 视频堆栈渲出一段约 10 秒的视频,自带原生音频与环境配乐。Reddit 测试者反馈这是「我见过最好的视频模型之一,也许不是*最好的*,但表现非常强」 —— 尤其在 prompt 遵循度上。

3. 在对话里 Remix

别打开编辑器。直接打字「演员眼睛特写更紧」「桌中央的摆件换成蜡烛」「加点轻柔背景钢琴」。Google Omni 只重渲改的部分,剩下的镜头保留。

4. 渲染并分享

导出最终片段。把对话作为公开模板分享,其他人可以分叉你的 prompt。Google 在 I/O 2026 正式发布 Omni 时,你工作台里每段视频都会自动以更高品质重新渲染。

Google Omni AI 视频生成器 —— 核心能力

Gemini Omni 在泄露的 UI 里预告的每一项能力,今天就在工作台里跑。

对话编辑视频

用大白话描述改动。Google Omni 只重渲差异,保留你没改的部分。Omni 的核心交互模式,今天就能用。

一键 Remix

每段生成视频都是种子。秒级生成变体 —— 同一场景,不同打光、不同主角、不同季节。

泄露的 Omni 模板

从 Reddit 测试者在泄露的 Gemini Omni 界面里用过的同样六个 prompt 起手 —— 黑板演算、海边对话、产品开箱等 —— 再用对话弯曲它们。

原生音频 + 配乐

合成语音、房间环境音与场景配乐 —— 一次渲出。Reddit 测试者称音质「比 Veo 好得多,差距相当大」。

无缝多机位

单镜头内多机位切换,跨切点动作连贯。Phemex News 与 Reddit 测试者标记的 Omni 招牌视觉手法。

自动升级到 Omni

今天底层使用 Gemini 视频堆栈(Veo 3.1)。Google 在 I/O 2026 正式发布公开 Omni 时,工作台自动切换。

Google Omni vs Veo 3.1 vs Sora 2 —— 谁今天能用?

Google Omni 在 2026 年 5 月视频 AI 版图中的位置 —— 它扩展的 Gemini Veo 3.1 堆栈、以及 2026-04-29 关停消费版的 OpenAI Sora 2。

Google Omni —— 定义性的 chat-edit 模式

状态:2026-05-02 泄露;预计 Google I/O 2026(5 月 19-20 日)正式发布。Chat-edit 视频、一键 Remix、原生音频与环境配乐、无缝多机位。今日通过 aigeminiomni.org 在 Gemini 视频堆栈上使用;Google 一发布官方 Omni,自动切换。

Veo 3.1(Toucan)—— 现行生产 Gemini 视频

内部代号 Toucan。当前驱动 Google 生产环境的 Gemini 视频生成,4K 输出 + 原生生成音频。gated、按地域限制、仅 Gemini Advanced 订阅可用。Omni 扩展的就是这个模型 —— 这意味着你今天练习的 chat-edit 工作流已经跑在 Omni 的地基上。

Sora 2 —— 2026-04-29 关停

OpenAI 已于 2026-04-29 关停 Sora 2 消费版 App。Google 公开回应「video's here to stay」,加速 Omni 在 I/O 2026 的发布。Sora 2 时代结束了;Omni 时代是下一章 —— 而你现在就能在里面练。

谁在 Google Omni 工作台里干活

Google Omni 工作流不只是更快的 Veo —— 它是你和视频模型之间一种不同的关系。「先生成-再混剪」通过对话进行的人,会从中获益最多。

TikTok / Reels / Shorts 短视频创作者

从一句对话描述生成首版。在对话里同时混剪竖版、横版、方版。在画布内调高 BPM 或换主色调。Google Omni 的一键 Remix 与「要变体、不要完美」的发版节奏天然契合。

独立电影人与样片导演

10 秒钟搭出一个场景,再决定要不要去勘景。在对话里测试镜头语言、打光、对白节奏。Omni 工作台变成不要钱的预演工具。

效果广告与品牌工作室

从同一条对话里出 30 版广告变体。每次 Remix 保留品牌框架,只换 offer、标题或主视觉。原生音频让早期测试不用单独申请 VO 预算。

教育与课程创作者

生成带屏幕内数学公式、图表、黑板文字的讲解视频 —— Reddit 测试者证明 Google Omni 在这类内容上做得很稳。在对话里改语言或节奏,无需重录。

Google Omni —— 关键数据

2026 年 5 月 Gemini Omni 泄露窗口期的可验证数据点。

5 月 2 日 2026 年 Gemini Omni UI 首次被发现

2026 年 Gemini Omni UI 首次被发现

80.6K TestingCatalog 泄露帖的浏览量

TestingCatalog 泄露帖的浏览量

5 月 19 日 Google I/O 2026 —— 预计 Omni 发布

Google I/O 2026 —— 预计 Omni 发布

早期测试者怎么评价 Google Omni

关于 Gemini Omni 视频模型的可验证泄露与一手反馈。每条引用均附原始来源 —— Reddit、X 或具名媒体的链接。

我不会撒谎,这是我见过最好的视频模型之一 —— 也许不是*最好的*,但表现非常强。语音质量比 Veo 好得多,差距相当大。它甚至加了一段轻柔背景音乐。

@Zacatac_391, Reddit r/GeminiAI · 早期测试者 · 2026-05-11

@Zacatac_391

Reddit r/GeminiAI · 早期测试者 · 2026-05-11

Gemini 显然要上一款新的视频生成模型,「Omni」给出的初步结果挺让人印象深刻的。视频在处理画面文字上做得很好,整体相当真实。

Ben Schoon, 9to5Google 主编 · 2026-05-11

Ben Schoon

9to5Google 主编 · 2026-05-11

GOOGLE I/O:在 Gemini 上发现了 Gemini Omni 视频模型即将上线的新证据。根据描述,我们这次可能真的在谈论基于 Gemini 的真正「Omni」模型 —— 而不是 Veo。

@testingcatalog, X 上的 AI 资讯 · 80.6K 阅读 · 2026-05-11

@testingcatalog

X 上的 AI 资讯 · 80.6K 阅读 · 2026-05-11

一个令人印象深刻的 Gemini「Omni」视频模型刚刚在 Google I/O 之前泄露。Remix 视频、直接在对话里编辑 —— 这套工作流是它和我们今年见过的所有其他视频 AI 不一样的地方。

Robby Payne, Chrome Unboxed · 2026-05-11

Robby Payne

Chrome Unboxed · 2026-05-11

新 Omni 模型不仅视频做得好 —— 它还能跨这些媒介推理。你拿到了那个据说能结合一切的大新模型的早期访问:视频、音频、文本、图像。

u/Street_Celebration_3, Reddit r/GeminiAI 社区评论 · 2026-05-11

u/Street_Celebration_3

Reddit r/GeminiAI 社区评论 · 2026-05-11

Google 似乎正在 Gemini 内部测试一个名为 Omni 的新视频生成模型,相关线索是 Google I/O 2026 前发现的一段 UI 字串:「Start with an idea or try a template. Powered by Omni.」

WaveSpeed AI Research, 视频基础设施博客 · 2026-05-03

WaveSpeed AI Research

视频基础设施博客 · 2026-05-03

Google Omni AI 视频生成器 —— 常见问题

关于 Gemini Omni 视频模型泄露、今天如何使用工作台、以及 Google I/O 2026 当天自动升级机制的常见问题。